Facebook i patologie automatycznej moderacji

Świat wokół nas, którego nie zobaczymy.

Kadry z filmu „Sierota”, przeróbki moje.

Stanął w ogniu nasz wielki dom

Dym w korytarzach kręci sznury

(…)

Lecz większość śpi nadal, przez sen się uśmiecha

A kto się zbudzi, nie wierzy w przebudzenie

Krzyk w wytłumionych salach nie zna ech

Na rusztach łóżek milczy przerażenie

Jacek Kaczmarski, „A my nie chcemy uciekać stąd”

(w linku wykonanie Przemysława Gintrowskiego).

Wybaczcie mi proszę słowo „przebudzenie”. Wiem że w obecnych czasach może się kojarzyć z bełkotem teoretyków spiskowych. Ale ta piosenka bardzo mi pasowała do grafiki i po prostu musiałem jej użyć ![]()

A co do samej treści obiecuję, że będzie niespiskowo i praktycznie. Jak zawsze!

Bo widzicie – mamy na świecie całkiem realny problem z moderowaniem komentarzy na wielkich portalach internetowych. Pomijając niechęć niektórych osób do samej idei moderacji, zwyczajnie nie starczyłoby do tego ludzi.

Zatem na pierwszą linię rzuca się automaty. Wykrywające, usuwające albo chowające wypowiedzi, które są w ich oczach spamem. Rozwiązuje to niektóre problemy, ale też tworzy zupełnie nowe.

Pokażę tutaj, w jaki sposób algorytmy Facebooka chowają niekiedy całkiem ciekawe i wartościowe treści. Przyczyniając się do zamykania ludzi w ich własnych bańkach informacyjnych. I dając amunicję wszelkiej maści spiskowcom i trollom, którzy mogą potem twierdzić, że serwis ukrywa prawdę o świecie.

Na deser będzie też skrypt pozwalający samodzielnie wyłapywać, jakie komentarze Facebook przed nami ukrył.

Tu coś dla osób, które nie lubią czytać tekstów dłuższych niż tweet i mogłyby nie dotrwać do końca.

Facebook, zapewne przez wady algorytmów, często ukrywa komentarze pod postami. Żeby je zobaczyć, klikajmy opcję Najtrafniejsze i zmieniajmy ją na Wszystkie. Można znaleźć fajne rzeczy.

Spis treści

- Opcje dotyczące komentarzy

- Przegląd ukrytych komentarzy

- O co w tym wszystkim chodzi?

- Co zrobić?

- Bonus: wyłapywanie ukrytych komentarzy

Opcje dotyczące komentarzy

Załóżmy, że jesteśmy sobie niedzielnymi użytkownikami Facebooka. Przewijamy tablicę (swoją albo jakiejś strony) i dostrzegamy jakiegoś posta. Według podpisu zostawiono pod nim 5 komentarzy. Ale kiedy klikniemy, żeby je rozwinąć, widzimy tylko dwa.

Pierwsza myśl – jeśli w ogóle poświęcimy temu uwagę – „ktoś je ręcznie usunął”. Zapewne autor posta. Może były spamowe albo obraźliwe?

Czytamy te dwa komentarze, które zostały. Nic ciekawego, przewijamy dalej. Tak jak miliony innych osób każdego dnia.

A tymczasem prawda jest nieco inna. Te komentarze wcale nie były usunięte, były tylko ukryte. Przez Facebooka.

I to raczej nie przez złą wolę czy celowe działanie jakichś ludzi z działu moderacji. Bardziej prawdopodobne wyjaśnienie: ich komputery przeanalizowały treść i wyliczyły… Właściwie nie wiemy co, bo działanie algorytmów jest dla nas nieprzeniknione.

W każdym razie na podstawie tych wyliczeń Fejs ukrył komentarze. A my możemy je odsłonić.

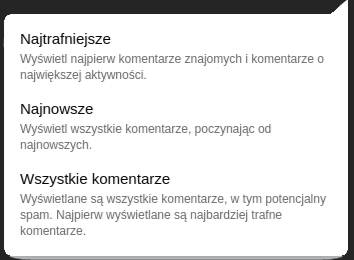

W tym celu, po pierwszym wyświetleniu listy komentarzy, klikamy na słowo Najtrafniejsze (po angielsku Most relevant albo Top comments), widoczne zaraz pod opcją udostępnienia posta. Rozwinie się lista opcji:

Kiedy z tej listy wybierzemy opcję Wszystkie komentarze albo Najnowsze, to zapewne zobaczymy ukryte komentarze. Jeśli nadal będzie ich mniej niż według licznika u góry, to znaczy że niektóre zostały usunięte na amen. Może przez autora posta, może przez Facebooka. Ale zwykle zobaczymy coś nowego.

Żeby być uczciwym wobec Facebooka – nie robią z tego wielkiej tajemnicy. Kiedy przewijamy komentarze, to czasem pojawia się między nimi tekst:

Wybrano tryb sortowania Najtrafniejsze, więc niektóre odpowiedzi mogły zostać pominięte w wyniku filtrowania.

Dotyczy to jednak dłuższych wymian komentarzy, gdy luki utrudniałyby czytanie dialogu. Wiele innych komentarzy jest niestety chowanych po cichu.

Przegląd ukrytych komentarzy

Wiemy już, jak odsłaniać komentarze. Spójrzmy teraz, co się w nich kryje.

Czasem to rzeczy prozaiczne, faktyczny spam. Gdybyśmy wyłączyli filtr komentarzy pod jakimś mainstreamowym artykułem, to bardzo możliwe, że jedynymi nowinkami byłyby takie wypowiedzi:

Ale nie dziękujmy jeszcze Facebookowi za to, że chowa przed nami te mądrości. Niestety trafiają się też przypadki bardziej kontrowersyjne.

Przypadek EFF

Zacznijmy od profilu Electronic Frontier Foundation. Jednej z większych organizacji nagłaśniających problemy nadużyć w świecie cyfrowym. Merytorycznej i niespiskowej.

Dygresja: trochę mnie dziwi, że przy ponad 190 000 obserwujących rzadko zbierają więcej niż kilkadziesiąt polubień pod postami. Niektóre inne strony, które omawiam w tym wpisie, mają podobne albo kilka razy mniejsze grono odbiorców, ale zaangażowanie dużo większe.

No ale wróćmy do wątku głównego. Po odwiedzeniu ich profilu przewijam w dół i znajduję post z 4 grudnia 2022, wspominający o platformie Mastodon (coraz popularniejszej alternatywie dla Twittera).

Nie podaję bezpośrednich linków do postów, żebyśmy mogli trochę poćwiczyć szukanie treści.

Jeśli już minęło sporo czasu od publikacji tego wpisu, to mój przykład z EFF pewnie odpłynął daleko w dół. Żeby łatwo go znaleźć, najpierw wchodzimy na profil EFF. Klikamy w ikonę lupy po prawej stronie, pod nagłówkiem profilu. Wpisujemy Mastodon. Potem wybieramy z menu opcję Wyszukaj "Mastodon" na tej stronie.

Analogicznie przy kolejnych przykładach. Będę podawał daty dodania postów i słowa pozwalające je znaleźć.

Dzisiaj, 18 grudnia, pokazuje mi 7 komentarzy przy ustawionym filtrze Najtrafniejsze. Widoczny jest jednak tylko komentarz niejakiego Michaela.

Jeśli widzicie więcej komentarzy, to jeszcze o niczym nie przesądza; jak później zobaczymy, możliwe że różnym użytkownikom ukrywa różne treści.

Kiedy zmienimy widoczność na Wszystkie, to pojawią się brakujące komentarze. Jak ten:

We wszystkich komentarzach usunąłem albo skróciłem nazwiska i nicki osób prywatnych.

Przy nim akurat mógłby zadziałać prosty filtr „niegrzeczności”, blokujący po złapaniu słowa twats.

Ten komentarz faktycznie nie miał zbyt wiele treści. Ale tym razem wydźwięk pozytywny (mimo że to miała być lekka prowokacja). Cokolwiek go usunęło, nie był to filtr wulgaryzmów.

Pod tym komentarzem jest jeszcze kilka, udzielonych w odpowiedzi na te słowa. Ale to akurat logiczne, że ukrycie komentarza-rodzica ukrywa też odpowiedzi, więc nie biorę ich pod uwagę.

Najbardziej kontrowersyjnym ukryciem jest moim zdaniem przypadek trzeci:

Komentarz na poziomie, gramatycznie poprawny, nieco antykorporacyjny (trying to protect me jest oczywiście ironią). Co więcej, zamieszczająca go osoba ma odznaczenie Lidera wśród fanów, czyli często udziela się na stronie.

Ale to odznaczenie nic nie zmienia, komentarz jest domyślnie ukryty. Zresztą patrząc po innych postach EFF, można zobaczyć że podobny los spotyka wiele komentarzy tej konkretnej osoby. Czy słusznie? Niektóre komentarze faktycznie są ciut bardziej odjechane, ale nie widziałem nic skandalicznego.

Ten przypadek może być dla nas cenną poszlaką. Być może przy ukrywaniu komentarzy Facebook bierze pod uwagę jakąś abstrakcyjnie rozumianą reputację użytkowników.

Pod spodem na profilu EFF znajdziemy jeszcze inny post, z 17 listopada. Na temat nie tyle Mastodona, co szerszego zjawiska Fediverse.

Tam również są usunięte komentarze. Jeden od tego samego F.M.A. co wcześniej (tym razem nieco bardziej bojowniczy). A także komentarz linkujący do instrukcji przechodzenia na nową platformę:

Może jakiś użytkownik wypatrywał informacji o alternatywach, chciał zmienić platformę. Ale, nie wiedząc o ukrywaniu komentarzy, właśnie przeoczył pomocny poradnik. Zatem zostanie na Twitterze, zatem podupadnie na zdrowiu psychicznym. Efekt motyla i te sprawy ![]()

Przypadek DuckDuckGo

DuckDuckGo to przede wszystkim alternatywa dla Google, reklamująca się większym szanowaniem prywatności użytkowników. Czy słusznie – to osobna sprawa, ale zawsze to kolejny krok z dala od ekosystemu Wujka G.

Pod niektórym postami na ich profilu, które sprawdziłem wyrywkowo, ukryte komentarze faktycznie były głównie spamem, oznaczaniem znajomych i tak dalej.

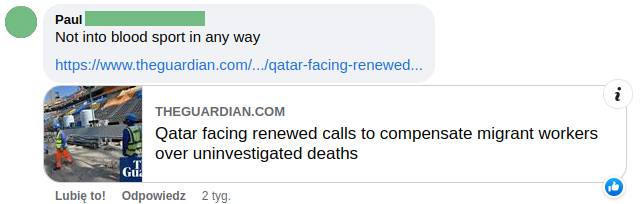

Ale pod postem nawiązującym do mistrzostw w Katarze (z 18 listopada, słowa kluczowe World Cup) znajdziemy coś ciekawszego. Dwa ukryte linki, podesłane przez osoby bojkotujące zawody. Oto jeden z nich:

Link do Guardiana. Nie każdy musi się zgadzać z ich linią redakcyjną; sam mam neutralne podejście, choć cenię niektóre dokonania ich dziennikarstwa śledczego.

Tak czy siak nie sposób im odmówić, że są gazetą dużą i znaną. To nie jest jakiś link do stronki spiskowej. A jednak komentarz został ukryty.

Nawet gdyby algorytm Facebooka odrzucał z automatu te komentarze, które zawierają sam link i zero treści, to i tak nie dotyczyłoby to tego przypadku. Bo oprócz linku jest parę słów od autora. Krótkich i zrozumiałych.

Co zatem było przyczyną ukrycia? Liczba prób zgłoszenia komentarza? Reputacja autora? Tematyka? Nie dowiemy się.

A osoby, które jeszcze nie usłyszały o kontrowersjach związanych z mistrzostwami, może nigdy ich nie poznają. Pozostaje im grzeczne przewijanie i konsumowanie treści.

Przypadek Niebezpiecznika

Spójrzmy na jakąś polską stronę! Na przykład Niebezpiecznika, jedną z większych poświęconych cyberbezpieczeństwu. Ale, jako że to nie moja branża, niech będzie sprawa spoza ich codziennej działalności.

Apple wypuściło na swoją platformę Apple TV nowy serial, który w polskim tłumaczeniu nazywa się… właśnie „Niebezpiecznik”.

W odpowiedzi ten prawdziwy Niebezpiecznik opublikował posta (3 listopada, słowa kluczowe Apple TV). Proszą o nagłośnienie sprawy i linkują do artykułu pokazującego, w jaki sposób taka kolizja nazw może zaszkodzić ich marce.

Poukrywane komentarze są różne. Mem z Clintem Eastwoodem, jakieś losowe śmieszki. Komentarz nieironicznie twierdzący, że… powinni się cieszyć zainteresowaniem od Apple ![]() Ale schowano też konkrety, jak link do strony pozwalającej zgłaszać Apple naruszanie praw autorskich.

Ale schowano też konkrety, jak link do strony pozwalającej zgłaszać Apple naruszanie praw autorskich.

Tak jak wyżej, raczej nie rozpracujemy zasad, jakimi kierował się algorytm.

Ale ten przykład jest dla nas ciekawy pod innym względem. Ukryto również komentarz, który zebrał 21 reakcji (polubień i śmiechów) oraz odpowiedź samego Niebezpiecznika. Co doprowadziło do ukrycia również tejże odpowiedzi.

Gdyby ktoś postawił tezę „Odpowiedzi od strony-autora zawsze chronią komentarze przed schowaniem”, to tu mielibyśmy dowód na jej fałszywość.

Lajki oraz odpowiedzi od autora posta nie chronią przed ukryciem komentarza. Albo trochę chronią, ale nie zawsze. W każdym razie autorzy raczej nie uratują swoich użytkowników przez wchodzenie z nimi w interakcje.

Przypadek Doniesień z putinowskiej Polski

Tutaj spojrzymy na wątek, który jest mi dość bliski. Bo sam też o nim pisałem. Chodzi o sprawę wokół amerykańskiej filii Syngenty oraz ich produktu, atrazyny.

W skrócie: substancja ta miała zwyczaj przedostawać się do wód gruntowych i źle wpływać na układ hormonalny organizmów wodnych. Kiedy różni naukowcy zaczęli nagłaśniać sprawę, to koncern, zamiast dokładniej to zbadać, wziął się za niszczenie ich reputacji.

Doniesienia z putinowskiej Polski to profil, na którym nie spodziewalibyśmy się tej sprawy. Na co dzień pisze o aferach i skandalach polityczno-militarnych, zwykle z Rosją w tle. A jednak, o dziwo, sprawa żab również trafiła do komentarzy.

Kiedyś mianowicie na Doniesieniach zagościła informacja o tym, że sąd nakazał znanemu showmanowi z USA wypłatę odszkodowania. Opublikowano ją 13 października, można wyszukać po słowach była mistyfikacją.

Chodzi o osobę o inicjałach A.J. Zapewne kojarzycie. Facet miał zwyczaj brać różne informacje, czasem oparte na faktach, i klecić z nich niestworzone teorie spiskowe. Nie wymienię go z nazwiska, żeby nie przyciągnąć foliarzy na bloga ![]() .

.

Jedna z teorii showmana bazowała właśnie na „żabiej aferze”. W komentarzach pojawiły się zatem zarówno osoby śmieszkujące z interpretacji A.J., jak też ludzie wyjaśniający, o co w tym naprawdę chodziło. I nie, Facebook nie pousuwał faktów na temat afery. Wykazał się natomiast kolejną niekonsekwencją. Spójrzmy:

Dwa linki od tej samej osoby, w zbliżonym czasie. Pierwszy do artykułu naukowego na stronie uczelni, w domenie gov. Drugi do filmiku na YouTubie.

Link numer jeden był ukryty, ten do YouTube’a przetrwał.

I choć nie mam nic do filmu Okiego – jest bardzo solidnym omówieniem sprawy! – to jednak decyzja algorytmu jest ciut dziwna. Sugeruje, że chowanie linków niekoniecznie bazuje na jakiejś reputacji domen. I nie chodzi tu raczej o reputację linkującego, bo ten w obu przypadkach był ten sam.

Bardzo podobną niekonsekwencję zobaczymy w ukrywaniu komentarzy twierdzących, że to samo mogłoby spotkać znanego polskiego znachora:

Ten sam wydźwięk. Pierwszy komentarz schowany, drugi nie. Skąd różnica? Czy możliwe, że „powinien tak skończyć” skojarzyło się algorytmowi z jakimiś agresywniejszymi komentarzami i dlatego oberwało?

Możemy też pomyśleć, że krótkie komentarze są gorzej punktowane; na przykład skojarzą się algorytmom z kłótniami internetowymi, zakończonymi zbanowaniem jakiegoś uczestnika.

Ale Facebook schował również inny komentarz. Który wprawdzie wywołał drobną dyskusję, ale był dość refleksyjny, bez bluzgów. I długi:

(…)

dostaniesz nakaz sądowy i pozew na 100mln za oczernianie koncernu. Oczywiście możesz spróbować wynająć naukowców, zrobić badania na tysiącach osób i się obronić przedstawiając wiarygodniejsze badania niż te, którymi dysponuje koncern, ale raczej ci się nie uda. Powstał system, który przypomina wolność słowa w Chinach lub Korei Płn, nie możesz tam pewnych osób krytykować ani nawet publicznie wątpić, bo za słowa zostaniesz zniszczony, nie zostaniesz wyśmiany, zostaniesz zniszczony, zabiorą ci dom, samochód, pieniądze, stracisz rodzinę. Dlatego ten system jest zły, bo zamyka usta nie tylko tym złym, zamyka usta wszystkim.

Przypadek Ciekawostkawki

Już nam runęło trochę potencjalnych założeń na temat autocenzora z Facebooka, ale możemy pomyśleć sobie jedno – być może ma jakąś swoją czarną listę linków?

Spójrzmy do miejsca bardziej mainstreamowego. Ciekawostkawka – grupa licząca ponad 250 000 użytkowników i służąca wymienianiu się mniej znanymi faktami z życia. Znajdziemy tu pełen przekrój społeczeństwa! Niektóre tamtejsze komentarze to okrutny rak, ale trafia się też szczere złoto.

Tutaj również wrzucono temat wyroku dla showmana z USA. Również śmieszkowano z jego słów o żabach. Jeden użytkownik, chcąc pokazać realną aferę, podlinkował ten sam film Okiego z YouTube’a, który pokazałem wyżej.

Tylko że na Doniesieniach link został przepuszczony, w przeciwieństwie do artykułu naukowego od tej samej osoby. A na Ciekawostkawce został ukryty. Pozostaje chyba odrzucić kolejne założenie na temat reguł działania automoderacji. To raczej nie była żadna czarna lista filmów.

Być może przyczyną była sama postać komentującego z Ciekawostkawki, który kilka razy nagłaśniał na tej grupie kontrowersyjne (ale realne) sprawy? A może nie, bo wiele innych jego komentarzy przepuściło bez filtrowania.

O co w tym wszystkim chodzi?

Wytłumaczenie Facebooka

Najpierw oddajmy głos samemu Facebookowi. W zakładce z informacjami sami poruszają kwestię układania komentarzy pod postami:

Wyświetlane komentarze są objęte rankingiem i występuje większe prawdopodobieństwo, że zobaczysz wysokiej jakości komentarze odpowiednie dla siebie. To oznacza większe prawdopodobieństwo, że u góry zobaczysz:

- Komentarze lub reakcje znajomych.

- Komentarze ze zweryfikowanych profili i stron.

- Komentarze z największą liczbą polubień i odpowiedzi.

W zakładce making public comments more meaningful przedstawicielka Facebooka pokazuje więcej przykładów. Przy szeregowaniu komentarzy brane są ponoć pod uwagę opinie z losowych ankiet wśród użytkowników. Albo historia interakcji (co było najczęściej lajkowane i wywoływało dyskusję).

Oba teksty sugerują, że jakieś znaczenie ma fakt, czy pod komentarzem napisał coś sam autor posta. Ale, jak widzieliśmy przy Niebezpieczniku, nie jest to reguła absolutna. Potrafiło schować lajkowany komentarz wraz z ich odpowiedzią (mimo że są nie tylko autorami posta, ale też kontem oficjalnie zweryfikowanym).

Informacje od Fejsa dają niby jakiś wgląd w algorytm. Tylko że to wszystko jest wymienione po magicznym słowie including, co oznacza że tak naprawdę kryteriów może być znacznie więcej. I zapewne tak jest, bo Facebook bez wątpienia stosuje metody uczenia maszynowego.

Kwestia uczenia maszynowego

O metodach uczenia maszynowego, nazywanych AI (sztuczną inteligencją), już kiedyś napisałem.

Mówiąc krótko – nie mają nic wspólnego z prawdziwą, „świadomą” inteligencją. Jasne, to bardzo złożone metody i są stale doskonalone. Ale to wciąż tylko narzędzie. Tak jak opcja stworzenia wykresu albo autoformatowania w Excelu.

W ramach uczenia maszynowego wrzucamy komputerowi wiele różnych danych. A on je przetwarza i ma za zadanie wychwycić, które z nich często pojawiają się razem.

„Masz tu przykłady komentarzy, które ludzcy moderatorzy zbanowali. A tu takie, które są w porządku. Znajdź cechy, które pozwalają rozróżnić te grupy”.

Komputer drąży, mieli, znajduje jakieś swoje powiązania. Tylko że kompletnie nie muszą one odpowiadać temu, co pomyślałby żywy, świadomy człowiek. To wypadkowa wielu rzeczy, jak na przykład długość komentarza, data, liczba wszystkich komentarzy danej osoby…

Nie wyobrazimy sobie tego wszystkiego, podobnie jak nie bylibyśmy w stanie przeprowadzić w głowie fizycznej symulacji.

Ale pozwolę sobie chwilę poteoretyzować. Jeśli komputer chciałby rozdzielić komentarze na różne grupy, to jakie cechy mógłby uznać za istotne?

-

Do banowania kont zapewne nieraz dochodzi po kłótniach w komentarzach. Jak kłótnie, to wulgaryzmy. Zatem algorytm mógłby sobie stworzyć nieformalne „czarne listy słów”.

Efektem ubocznym mogłoby być chowanie wszelkich komentarzy z wulgaryzmami. Nawet jeśli ich wydźwięk był pozytywny (it’s f*cking delicious). Albo, co gorsza, jeśli pojawi się jakieś słowo dwuznaczne dla algorytmu („jakie polecacie pedały do roweru górskiego?” na grupce sportowej).

-

W czasach Covida było wiele ożywionych dyskusji. Ludzie mogli się licytować na artykuły naukowe, zanim ktoś stracił cierpliwość i dostał bana za agresję.

Ale algorytm, patrząc na takie przypadki, mógłby uznać każdy komentarz z linkiem do strony amerykańskiej agencji ds. zdrowia za coś drażliwego. Mimo że to artykuły naukowe. Jest szansa, że częściej pojawiają się w komentarzach podczas ostrych dyskusji niż przyjaznych rozmów.

-

Jeśli algorytm patrzy na polubienia i reakcje, to pierwsze wrażenia mogą zakłamywać obraz.

Zapewne wiele osób wrzucało linki do kontrowersji wokół Mundialu na grupy fanów piłki.

Tylko że obstawiałbym, że ci ludzie nie przyjęli tego ciepło. Nie chcą widzieć ciemnych stron, chcą widzieć kopanie piłki. W takich warunkach komentarze nie zebrałyby lajków, a może nawet byłyby zgłaszane do usunięcia.

Na ogólniejszych grupach te skandale mogłyby lepiej się przyjąć, zaskoczyć ludzi, zebrać reakcje. Ale nie zbiorą niczego, jeśli algorytm już do tej pory sobie ubzdurał, że te linki lepiej chować.

Oczywiście wszystkie powyższe przemyślenia musiałbym wyrzucić do kosza, gdyby dla algorytmu miały znaczenie nie tylko cechy komentarzy, ale również mojego własnego konta.

Czy tak jest? Nie wiem. Jak już podkreślałem, algorytm to trochę czarna skrzynka. Choć słowa „zobaczysz komentarze odpowiednie dla siebie” z oficjalnych wyjaśnień Fejsa niestety to sugerują.

Ale wiem coś innego. Gdyby algorytm kierował się cechami naszego konta, to każdy dostawałby własny, szyty na miarę mikroświat. Tylko że niekompletny w porównaniu z tym prawdziwym. Odarty z tego, co zdaniem komputerów Facebooka do nas nie pasuje.

Błędne koło automoderacji

Ktoś mógłby pomyśleć: „Ale o czym my tu w ogóle gadamy? Chcesz widzieć wszystko bez cenzury, to klikaj taką opcję”.

Na poziomie osobistym może to pomóc. Ale działania nieprzeniknionych algorytmów mogą mieć konsekwencje również na poziomie społecznym, światowym.

Dochodzi do swoistego sprzężenia zwrotnego:

- Jakiś rosyjski troll spamuje platformę treściami dezinformacyjnymi.

- Zostaje zgłoszony i zbanowany.

-

Algorytm analizuje, co było w jego komentarzach. Staje się wyczulony na pewne treści.

Gdyby świat był idealny, to tu byśmy skończyli. System moderacji działałby trochę jak układ odpornościowy człowieka. W praktyce oczywiście nie jest tak fajnie.

- Parę teorii spiskowych było przeinaczeniem nieco prawdziwszych afer. Przeczulony algorytm ukrywa również wzmianki o nich. Treści prawdziwe i wartościowe, choć kontrowersyjne.

- Kręgi spiskowe to zauważają i pokazują wyraźne dowody na to, że platforma coś chowa. Nie nazywają tego wadami algorytmu, tylko celowym „ukrywaniem prawdy”.

- Takie argumenty przekonują nawet osoby nieco bardziej umiarkowane. Po zradykalizowaniu zaczynają spamować platformę dezinformacją…

I tak dalej. Krąg się zamyka, świat się radykalizuje.

Gdyby chodziło tylko o komentarze, to jeszcze pół biedy. Ale na podobnie niejasnych zasadach może dochodzić również do banowania kont – firmowych i nie tylko.

I nie jest to problem samego Facebooka. Również YouTube „szczyci się” nieprzeniknionymi regułami usuwania kont i wyłączania opcji zarobkowania.

Wielkie platformy chętnie przygarniają użytkowników, twierdząc że miejsca starczy dla wszystkich. Wabią inwestorów, mówiąc że mają nowoczesne techniki moderacji, że to świetna przestrzeń do zarabiania na reklamach.

Brakuje refleksji nad tym, że cały ten system jest niestabilny, a jego słabości są cały czas wykorzystywane. Również przez siewców dezinformacji.

W takich realiach wniosek wydaje mi się prosty – bycie przeciwko algorytmicznej cenzurze nie jest oznaką myślenia spiskowego. To wręcz racjonalna próba uspokojenia świata. Który w obecnym układzie tylko coraz bardziej się radykalizuje.

Co zrobić?

Po stronie Facebooka wystarczyłoby, żeby przestał domyślnie ukrywać pełnoprawne komentarze.

Ktoś powie, że upraszczam? Ale to naprawdę nie takie trudne. Wciąż mogliby łatwo, zwykłym dopasowaniem tekstu, wyłapywać przypadki, gdy komentarz jest jedynie wywołaniem znajomej osoby albo paroma emotami.

A poza takim spamem? Po prostu nie chować. Nie niańczyć użytkowników. Niech ludzie widzą czasem, że świat ma całkiem realne, ciemne strony. Tryb Wszystkie powinien być tym domyślnym.

To tyle, jeśli o Facebooka chodzi. A co z użytkownikami?

Osoby piszące komentarze mogłyby się starać, żeby były nieco dłuższe i pozbawione wulgaryzmów. Szansa na ukrycie byłaby raczej mniejsza. A jako efekt uboczny – internet stałby się nieco bardziej kulturalny ![]()

A my, czytelnicy komentarzy? Rozwiązanie jest póki co proste. Zawsze po rozwinięciu komentarzy klikajmy opcję Wszystkie. Zobaczymy świat takim, jakim jest naprawdę.

Jeśli odkryjemy, że jakieś ciekawe komentarze zostały schowane, to możemy o tym napisać własny komentarz pod tym samym postem, przekonując ludzi do odhaczenia filtra.

Gdyby ktoś się nam dziwił i napisał, że wszystko widzi, to pamiętajmy że filtry mogą różnie działać dla różnych osób.

To tyle na dziś! Chyba że ktoś chce osobiście wyłapać parę przypadków poukrywanych komentarzy. W takim wypadku służę sprawdzonym (choć tylko przez siebie) skryptem ułatwiającym pracę.

Bonus: wyłapywanie ukrytych komentarzy

W jaki sposób możemy znajdować komentarze, które Facebook przed nami ukrył?

Mówiąc najogólniej: trzeba rozwinąć wszystkie komentarze widoczne w trybie ocenzurowanym. Skopiować je i gdzieś zapisać. Następnie zmienić tryb na nieocenzurowany i znów je porozwijać. Również zapisać. I porównać ze sobą obie wersje.

Oczywiście byłoby to mocno upierdliwe, gdybyśmy chcieli wszystko robić ręcznie. Dlatego stworzyłem skrypt Pythona, który wykonuje porównywanie i oznaczanie usuniętych komentarzy za nas (rozwijać niestety musimy sami).

W najprostszym przypadku:

- rozwijamy komentarze w trybie

Najtrafniejszei kopiujemy post do schowka; - włączamy skrypt i naciskamy

Enter; - rozwijamy komentarze w trybie

Wszystkie, kopiujemy post do schowka; - wracamy do okna ze skryptem i naciskamy

Enter.

I tyle. W aktywnym folderze powstanie nam, w formacie HTML, lista wszystkich komentarzy. Te schowane przez Facebooka będą oznaczone czerwonym brzegiem. Można zobaczyć, co platforma przed nami ukrywa ![]()

Żeby już nie zabierać miejsca w tym wpisie, przeniosłem instrukcję obsługi skryptu do osobnego samouczka. Zapraszam!

Jakaś Osoba

@Jakaś Inna Osoba zobacz haha